FPGA Robotics Vision för någon

Är du som mig intresserad av teknik och ville alltid att använda en av de tunga marker kallas FPGA'S? Är du intresserad av vision och robotics?

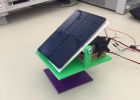

Mitt mål var att ta FPGA vision till folket, tillgänglig för alla. Jag bestämde mig att bygga min egen grundläggande visionsystem. Inte utifrån några FPGA tillverkare dyrt IP och hårdvara. Nej! Bara genom att använda en kamera, LCD-display som kan hittas någonstans på Ebay eller kinesiska webbshoppar.

Jag använde en prisvärd FPGA från Xilinx på en mycket prisvärd $31 utveckling ombord... det enda som krävs var massor av VHDL-kod!

Varför använde jag en FPGA för att göra detta? De flesta människor använder en mikrokontroller rätt? Och det finns alternativ där ute som ger din robot out-of-the-box grundläggande vision för ett rimligt pris som TOPPLUVA CMUCAM5. Jag äger en, det är baserat på 2 ARM microcontrollers. Jag använde en FPGA på grund av dess oerhörda makt att göra alla typer av aktiviteter i parallellt vilket gör det mycket användbart för en aktivitet som Vision. Och eftersom jag tror att det finns fler peope som mig som vill använda en FPGA men visste inte var jag ska börja.

Resultatet är ett realtid 30fps imaging system med grundfärg upptäckt. Detta kallas "tresholding". Vad den gör är att jämföra QVGA bilder från kameran på 30fps med en fördefinierad "mask" för R, G och B komponenter. Systemet "ställen" fördefinierade färg och visar detta på 320 x 240 (QVGA) LCD. Pixlar som uppfyller villkoret "mask" visas vitt och de som inte följer bo svart.

Just nu (i VHDL-kod) är denna "mask" en nästan vit färg. Detta innebär att de R, G och B komponenterna är nästan på deras maximum.

Jag har också genomfört "Mall matchande". Detta innebär att du kan jämföra en pre lagrade kamerabild till en extern FIFO minne (design av styrelsen ingår) med realtid bilder från kameran och se skillnaderna realtid på LCD-skärmen! Jag tar detta senare till

Känn dig fri att använda min för att experimentera och kanske genomföra egna algoritmer.