Urban Design - musik från ansiktsuttryck - ljud av känslor (6 / 13 steg)

Steg 6: Utveckling av programvara i Full gång

Efter flera programvara utveckling möten, en arkitektur föreslogs och kommit överens om. "ThinSOM," vår egen iPad app skulle skapas för att fånga ansiktsuttryck och skicka dem till vår egenutvecklade "SOM" server. Servern uppmanar Emotients för taligenkänning för att analysera ansikten, då fungerar som en domänkontrollant, utlöser en mjukvaran program, Ableton Live, för att verkställa musikspår.

Även om vi skulle analysera alla sju känslor, efter att ha gjort inledande analys på komplexiteten för en installation på gatan, gjorde vi en förenkla beslut att be deltagarna att MIME-endast två stater (glad och ledsen).

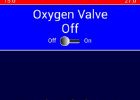

Det skulle finnas fyra iPads, alla med egen app och en MAC för att köra servern och Ableton, gömd i en elektronik låda längst ner. Kommunikation mellan enheter skulle utföras via ett trådlöst ad hoc-nätverk.

Arkitekturen ändrats flera gånger under loppet av utveckling som kompromisser har gjorts om hur den app och server kommunicerade med varandra, vilken entitet skulle göra flesta av behandlingen och hur status uppdaterades till deltagaren. Under perioden av utveckling skrevs ungefär 4000 rader kod totalt. De primära språk var C, C++ och mod_perl.